La teoria della probabilità si occupa dello studio dei fenomeni aleatori. Quando non siamo in grado di dare una caratterizzazione esatta del fenomeno e dobbiamo dare una descrizione globale del fenomeno stesso, usiamo la probabilità.

Sono aleatori tutti gli esperimenti per i quali è difficile o impossibile prevedere in modo esatto il risultato, ma presentano una qualche forma di regolarità. Il comportamento dei fenomeni aleatori può essere descritto solo attraverso grandezze globali e/o medie.

Non ci interessa solo il caso in cui sia impossibile, ma anche sia molto difficile, così tanto da rendere la descrizione irrealizzabile.

Pensando alla definizione di probabilità, i valori medi possono essere i momenti e le regolarità del primo o second'ordine. Tanto per dare un esempio, è difficile predire esattamente il risultato di ogni lancio del dado, ma se il dado non è truccato posso dire che ogni faccia ha la stessa probabilità di uscire. Posso prevedere il valor medio del risultato e la statistica collegata.

Teoria della probabilità e statistica

[modifica]La teoria della probabilità si occupa della costruzione di modelli probabilistici (matematici) che descrivano i fenomeni aleatori. La statistica, invece, si occupa di verificare l'aderenza di un modello rispetto ai dati sperimentali.

Nella parte di teoria della probabilità possiamo dire qual è la funzione di densità di probabilità del dado. La statistica si preoccupa di dire se, dato un dado, questo aderisce al modello della teoria della probabilità o se questo è truccato.

Gli ambiti in cui viene utilizzata la teoria della probabilità sono molti, per esempio:

- teoria delle code;

- instradamento ottimo dei pacchetti;

- analisi fatta a livello statistico;

- meccanica statistica relativa ai gas (posso descrivere la pressione, che è un valore medio, e non la posizione di ogni molecola);

- elaborazione e trasmissione dell'informazione.

La teoria dell'informazione studia i problemi legati all'elaborazione e alla trasmissione dell'informazione utilizzando un approccio probabilistico.

Esempio:

Se dico:

- oggi il treno per Milano delle 17.25 sarà in ritardo di 10 minuti

- oggi il treno per Milano delle 17.25 sarà puntuale

Pensando a come funzionano le ferrovie in Italia, qual è l'informazione più importante? La seconda, perché si verifica raramente: un evento raro è molto più informativo. La misura di informazione è basata sulla probabilità. L'informazione associata ad un evento è inversamente proporzionale alla sua probabilità di occorrenza.

L'informazione si misura con la definizione[1]

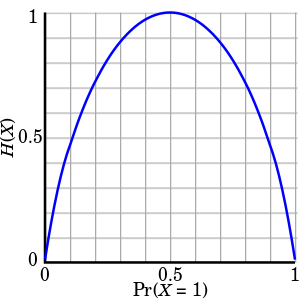

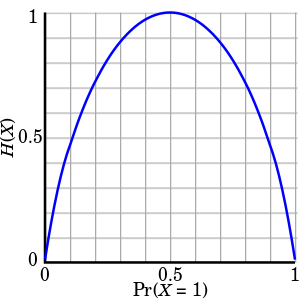

Dall'informazione  si passa alla definizione di entropia:

si passa alla definizione di entropia:

![{\displaystyle H(M)=\sum _{k=i}^{m}p(m_{k})\cdot i(m_{k})=\sum _{k=i}^{m}p(m_{k})\cdot \log {\frac {1}{p(m_{k})}}=E[i]{\text{ con }}m_{k}\in M}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5ab73f9c157cea5bf7dbbde540a48816c847dbd4)

L'entropia non è altro che l'informazione media di una sorgente.

Esempio:

Supponiamo di avere una sorgente

che emette simboli

0 e

1. La sorgente emette simboli in modo equiprobabile, quindi

Di solito si hanno delle stringhe di bit 1101110011. Un'operazione importante è la codifica della sorgente; quello che si vuole fare è trovare un codice per rappresentare questa stringa, con o senza perdita, con un numero minore di bit. Con la probabilità data non è possibile comprimere la stringa, perché i simboli sono equiprobabili.

Se i simboli sono indipendenti, il fatto che sia uscito un 1 o uno 0 non influenza il risultato del prossimo simbolo.

Al contrario, se i bit non sono equiprobabili, posso rappresentare con meno bit i simboli della sorgente, posso comprimere.

La costruzione di modelli semplificati può cambiare nettamente le prestazioni di un canale o di un sistema di telecomunicazioni.

Definizione: Fenomeno aleatorio

Un fenomeno aleatorio è un esperimento i cui possibili risultati appartengono ad un insieme ben definito e dove l'esito non è prevedibile (o predicibile) a priori.

È importante che l'insieme dei possibili risultati sia ben definito, deve essere noto.

Definizione: Spazio degli esiti

Lo spazio degli esiti, o spazio campione

associato ad un esperimento aleatorio, è l'insieme di tutti i possibili risultati di un esperimento. Può essere finito o infinito, sia

numerabile che

non numerabile.

Definizione: Evento

Dato uno spazio campione

, si dice evento un qualsiasi sottoinsieme A di

,

.

Esempio:

Si consideri il lancio di un dado a 6 facce. Si ha:

Definizione: Spazio degli eventi

Dato uno spazio campione  , si definisce spazio degli eventi F l'insieme non vuoto che contiene tutti gli elementi di interesse (determinabili su

, si definisce spazio degli eventi F l'insieme non vuoto che contiene tutti gli elementi di interesse (determinabili su  ) che soddisfano le seguenti proprietà:

) che soddisfano le seguenti proprietà:

(dai teoremi di De Morgan)

(dai teoremi di De Morgan)

Un spazio F è una  -algebra se vale anche:

-algebra se vale anche:

![{\displaystyle U_{i=1}^{k}A\in F\ \forall A_{1},\cdots ,A_{k},\ k\in [1,\infty ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/945685443abba220abdb65c504294a60a0d79eee)

cioè, se si ha chiusura rispetto all'unione numerabile. Noi useremo esclusivamente

-algebre.

Ci saranno, in generale, più di uno spazio F degli eventi. Il più banale deve contenere l'unione ed il complemento degli eventi.

Esempio:

Esempio di utilizzo della teoria della probabilità: il cut detection

In un filmato, si assume che frame vicini siano simili tra loro.

Qual è l'interframe, la distanza tra due frame?

Quando l'

interframe è troppo elevato, posso dichiarare che c'è stata una transizione del filmato. Posso usare soglie fisse o non fisse (le

soglie adattative). Grazie al modello probabilistico, si può introdurre la soglia adattativa, cioè che si adatta in base al modello di probabilità che stimo sui dati.

Definizione: Insieme delle parti

Si dice

insieme delle parti lo spazio degli eventi

F che contiene tutti i possibili eventi di

, cioè tutti i possibili sottoinsiemi che posso costruire con gli elementi di

.

Esempio: I dadi

L'insieme delle parti è

Definizione: Classi di insiemi

Dato un insieme X si dice classe C una collezione di sottoinsiemi di X. La classe di tutti i possibili sottoinsiemi di X si chiama insieme (o collezione, o classe) delle parti.

Definizione: Partizione di un insieme

Una partizione è la classe di sottoinsiemi

tali che

Esempio: Il dado

Con

, una partizione può essere

Definizione: Cardinalità

La cardinalità di un insieme è il numero di elementi che esso contiene. Se la cardinalità di

è

N, allora la cardinalità dell'insieme delle parti

F è

Probabilità secondo la frequenza relativa

[modifica]Una delle possibili definizioni di probabilità è quella che usa la frequenza relativa. Si dice che la probabilità  di un evento A è data da

di un evento A è data da

dove n è il numero di volte che si ripete l'esperimento, mentre  è il numero di volte che si verifica l'evento A.

è il numero di volte che si verifica l'evento A.

Probabilità secondo il modello probabilistico

[modifica]Un modello probabilistico di un fenomeno aleatorio è lo spazio di probabilità identificato da tre elementi  , dove:

, dove:

è lo spazio degli esiti;

è lo spazio degli esiti;- F è lo spazio degli eventi;

- P è la probabilità.

Definizione:

Probabilità

Assegnato uno spazio campione

ed una

-algebra

F di eventi di

, si definisce probabilità una funzione

P definita su

F a valori in

(non negativi), tale che

- se

è una successione di eventi mutuamente esclusivi, cioè

è una successione di eventi mutuamente esclusivi, cioè

Quest'ultima proprietà è detta additività numerabile, perché indica che gli elementi hanno intersezione nulla e la somma delle loro probabilità si può portare fuori dal segno di probabilità.

- ↑ Durante tutta la trattazione si usa la base 2. Questo perché qualsiasi insieme finito o infinito proprio può essere messo in relazione con l'insieme dei numeri naturali, e questi possono essere indicizzati con l'utilizzo dei soli simboli

. Inoltre, lo scopo del corso è permettere l'utilizzo di tecnologie di tipo digitale, che si basano proprio sulla base 2.

. Inoltre, lo scopo del corso è permettere l'utilizzo di tecnologie di tipo digitale, che si basano proprio sulla base 2.

![{\displaystyle H(M)=\sum _{k=i}^{m}p(m_{k})\cdot i(m_{k})=\sum _{k=i}^{m}p(m_{k})\cdot \log {\frac {1}{p(m_{k})}}=E[i]{\text{ con }}m_{k}\in M}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5ab73f9c157cea5bf7dbbde540a48816c847dbd4)

![{\displaystyle U_{i=1}^{k}A\in F\ \forall A_{1},\cdots ,A_{k},\ k\in [1,\infty ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/945685443abba220abdb65c504294a60a0d79eee)