Esercizio:

Siano le variabili casuali

e

, entrambe distribuite come

![{\displaystyle U[0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ef4a82b2a883d751cf53e5ac11ea12b9e36298f0)

. Studiare la variabile casuale data dalla relazione

Ergodicità dei processi casuali

[modifica]Supponendo di avere un processo stocastico  stazionario (in senso lato), andiamo a cercare di dedurre qualcosa dalla sua densità di probabilità

stazionario (in senso lato), andiamo a cercare di dedurre qualcosa dalla sua densità di probabilità  generando una realizzazione nel tempo. Vedremo che se il processo è ergodico, medie d'insieme e temporali coincidono.

generando una realizzazione nel tempo. Vedremo che se il processo è ergodico, medie d'insieme e temporali coincidono.

Consideriamo un processo  , con

, con  definito sullo spazio di probabilità

definito sullo spazio di probabilità  . Fissato l'esito

. Fissato l'esito  , otteniamo una realizzazione

, otteniamo una realizzazione  . Vogliamo capire se (e sotto quali condizioni) è possibile determinare delle caratteristiche di

. Vogliamo capire se (e sotto quali condizioni) è possibile determinare delle caratteristiche di  , osservando un'unica realizzazione.

, osservando un'unica realizzazione.

Se il processo è stazionario in senso lato, allora

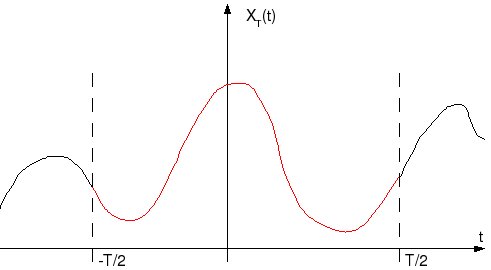

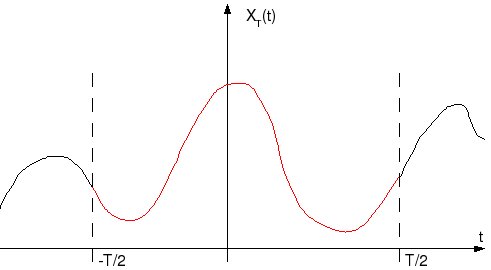

Consideriamo la realizzazione  in una finestra

in una finestra ![{\displaystyle \left[-{\frac {T}{2}},{\frac {T}{2}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f418869f4a5607f57dcac8bc259d1357eef94186) .

.

File:TFA realizzazione per ergodicita processi.jpg

Definizione: Stimatore del valor medio temporale

Si dice stimatore del valor medio temporale della realizzazione

la grandezza

che è la media temporale della realizzazione, sul periodo

. In generale,

è una funzione dell'esito

, quindi può essere considerata a sua volta una variabile casuale.

La grandezza  è una stima, si riferisce ad una particolare realizzazione

è una stima, si riferisce ad una particolare realizzazione  .

.

Definizione: Stimatore non polarizzato

Lo stimatore

è non polarizzato se

![{\displaystyle E\left[A_{X,T}(s)\right]=\mu _{X}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/48c08d3648342d00b450b094f34bb467df355205)

ossia se

![{\displaystyle E\left[A_{X,T}(s)\right]={\frac {1}{T}}\int _{-{\frac {T}{2}}}^{\frac {T}{2}}E[X(t,s)]dt=\mu _{X}=E[X(t)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6fee5fb3d7a4ea2a25602b1a977d2072db2b8340)

Il valor medio delle medie temporali coincide con il valor medio di insieme.

Definizione: Stimatore consistente

Uno stimatore

è detto consistente se

è non polarizzato

è non polarizzato- la varianza

tende ad annullarsi all'aumentare del tempo di osservazione

tende ad annullarsi all'aumentare del tempo di osservazione

- Questo equivale a dire che

tende, in maniera quadratica, al valor medio del processo, con un tempo di osservazione infinito si può ottenere il valore certo, senza incertezza.

tende, in maniera quadratica, al valor medio del processo, con un tempo di osservazione infinito si può ottenere il valore certo, senza incertezza.

Definizione: Processo ergodico

Se

è uno stimatore consistente di

, allora il processo

è ergodico.

Teorema: Teorema di Slutsky

Dato un processo

WSS (del second'ordine), allora

dove

indica la convergenza in norma quadratica e

è la funzione di autocovarianza del processo.

Il teorema di Slutsky permette di facilitare il compito di verifica dell'ergodicità di un dato processo. Una condizione sufficiente (ma non necessaria) affinché  sia ergodico è che

sia ergodico è che

Esempio:

Sia un processo

, con

una variabile casuale stazionaria in senso lato. Si ha

![{\displaystyle C_{X}(\tau )=R_{X}(\tau )-\mu _{V}^{2}=E[V^{2}]-\mu _{V}^{2}=\sigma _{V}^{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/538b4309fa42d67162da54c4bda44664a80f162c)

Dal teorema di Slutsky, si ha

quindi, il processo non è ergodico.

Esempio:

In modo alternativo, si può definire l'ergodicità del processo  nel seguente modo:

nel seguente modo:

- se

è WSS di prim'ordine, allora

è WSS di prim'ordine, allora

![{\displaystyle E[X(t)]=\mu _{X}(t)=\mu _{X}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/92ca89e61a152c86df0388e85d5cc855332aacdb)

- Di conseguenza, si ha che

è un processo ergodico rispetto al valor medio se è verificato

è un processo ergodico rispetto al valor medio se è verificato

- Questa si dice convergenza in probabilità, o convergenza qox (per quasi ogni

). Se

). Se  è continuo, possono esistere alcuni

è continuo, possono esistere alcuni  per cui non è verificata l'equazione, ma se questi punti sono isolati (concetto di qox), allora si ha comunque la convergenza cercata. La probabilità di un particolare

per cui non è verificata l'equazione, ma se questi punti sono isolati (concetto di qox), allora si ha comunque la convergenza cercata. La probabilità di un particolare  , infatti, è infinitesima (nel caso di processi a tempo continuo, lo stesso non vale per processi a tempo discreto).

, infatti, è infinitesima (nel caso di processi a tempo continuo, lo stesso non vale per processi a tempo discreto).

WSS del second'ordine è ergodico rispetto alla sua funzione di autocorrelazione se vale

WSS del second'ordine è ergodico rispetto alla sua funzione di autocorrelazione se vale

- Anche questa è una convergenza in probabilità, con

- che è l'autocorrelazione temporale del processo. In termini pratici, questo equivale a dire che

![{\displaystyle R_{X}(t,t+\tau )=E[X(t)X(t+\tau )]=R_{X}(\tau )=\varphi _{X,T}(\tau ,s)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/03309e54eb13ec9da8cd9713d3619100106c206b)

dove ![{\displaystyle E[\cdot ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/57d488a22bc9f41e976d3afb6036190bcbb36b2e) è la solita stima della funzione di autocorrelazione e

è la solita stima della funzione di autocorrelazione e  è l'autocorrelazione d'insieme, che viene a coincidere con l'autocorrelazione temporale

è l'autocorrelazione d'insieme, che viene a coincidere con l'autocorrelazione temporale  .

.

Consideriamo il processo  . Fissato

. Fissato  otteniamo una realizzazione che in generale rappresenta un segnale di potenza non periodico, quindi non è possibile dare una caratterizzazione frequenziale attraverso la trasformata di Fourier (in modo diretto). È tuttavia possibile caratterizzare i processi casuali almeno in termini di spettro di potenza. A questo proposito, consideriamo il processo

otteniamo una realizzazione che in generale rappresenta un segnale di potenza non periodico, quindi non è possibile dare una caratterizzazione frequenziale attraverso la trasformata di Fourier (in modo diretto). È tuttavia possibile caratterizzare i processi casuali almeno in termini di spettro di potenza. A questo proposito, consideriamo il processo

Limitatamente al periodo  , il segnale diventa ad energia finita,

, il segnale diventa ad energia finita,

quindi si ha anche lo spettro di potenza finito,

Definizione: Densità spettrale di potenza

Di definisce densità spettrale di potenza del processo

la grandezza

![{\displaystyle S_{X}(f)=\lim _{T\to \infty }{\frac {1}{T}}E\left[\left|X_{T}(f,s)\right|^{2}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/60b31597b3bc87a9a6456db47e998615a69211dc)

dove  è una variabile casuale ottenuta da

è una variabile casuale ottenuta da

che è la trasformata di Fourier della variabile casuale

.

Proprietà della densità spettrale di potenza

[modifica]- 1.

- 2.

è detto periodogramma del processo

è detto periodogramma del processo

- 3. Teorema di Wiener-Kinchine; se un processo stocastico è stazionario in senso lato (del second'ordine), allora si ha

![{\displaystyle S_{X}(f)=F[R_{X}(\tau )]=\int _{-\infty }^{+\infty }R_{X}(\tau )e^{-j2\pi f\tau }d\tau }](https://wikimedia.org/api/rest_v1/media/math/render/svg/98b6f65433bfd0a4b56a48117016f76bd0449093)

- 4. Se

è a valori reali, allora

è a valori reali, allora  è pari, di conseguenza si ha che

è pari, di conseguenza si ha che

- 5.

che è la potenza del processo

che è la potenza del processo

- 6.

![{\displaystyle R_{X}(\tau )=F^{-1}\left[S_{X}(f)\right]=\int _{-\infty }^{+\infty }S_{X}(f)e^{j2\pi f\tau }df}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dc8323e23c928318c206e600001abf0c5d90fc56)

Esempio:

Sia un processo stocastico

con

una variabile casuale con

qualsiasi. Si ha:

![{\displaystyle R_{X}(\tau )=E\left[X(t)X(t+\tau )\right]=E[V^{2}]=\sigma _{V}^{2}+\mu _{V}^{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/05c905302ce51d7b89262780d47efb97796144a7)

cioè, l'autocorrelazione

è costante, quindi la densità spettrale di potenza del processo è una

nell'origine.

Esempio:

Descrizione congiunta dei processi stocastici

[modifica]Consideriamo  e

e  due processi definiti sullo stesso spazio di probabilità

due processi definiti sullo stesso spazio di probabilità  . Se volessimo caratterizzare congiuntamente i due processi, dovremmo fare

. Se volessimo caratterizzare congiuntamente i due processi, dovremmo fare

e questo dovrebbe valere:

Questa è la densità congiunta finito-dimensionale; passando invece alle descrizioni sintetiche, si possono identificare:

![{\displaystyle \mu _{X}(t)=E[X(t)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/52a941c8b898eb09a4557571ffeb722d94054634)

![{\displaystyle \mu _{Y}(t)=E[Y(t)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/87706b91ec8f7ea5d29f99d5f7b09fdaaa8ff470)

- le funzioni di autocorrelazione

![{\displaystyle R_{X}(t_{1},t_{2})=E\left[X(t_{1})X(t_{2})\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/768107e0c44ef10811bebf152f63f783bad0cf96)

![{\displaystyle R_{Y}(t_{1},t_{2})=E\left[Y(t_{1})Y(t_{2})\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a27d345aa51487aa14ccee0a69eeab8bcf106791)

- le funzioni di covarianza

![{\displaystyle C_{X}(t_{1},t_{2})=E\left[\left(X(t_{1})-\mu _{X}(t1)\right)\left(X(t_{2})-\mu _{X}(t_{2})\right)\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b2b85c7203c174160c0ea9739ca0a5909d9f04b9)

![{\displaystyle C_{Y}(t_{1},t_{2})=E\left[\left(Y(t_{1})-\mu _{Y}(t1)\right)\left(Y(t_{2})-\mu _{Y}(t_{2})\right)\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5e9999373847279a66a4382830e533393e7c9fe2)

- le funzioni di crosscorrelazione

![{\displaystyle R_{XY}(t_{1},t_{2})=E[X(t_{1})Y(t_{2})]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d81b7d54e2b62ac7af05d4803798687962cc0130)

![{\displaystyle R_{YX}(t_{1},t_{2})=E[Y(t_{1})X(t_{2})]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/221bb8c7f8000a7e3cd414f25f9990c9a739ce63)

- le funzioni di crosscovarianza

![{\displaystyle {\begin{aligned}C_{XY}(t_{1},t_{2})&=E\left[\left(X(t_{1})-\mu _{X}(t1)\right)\left(Y(t_{2})-\mu _{Y}(t_{2})\right)\right]\\&=R_{XY}(t_{1},t_{2})-\mu _{X}(t_{1})\mu _{Y}(t_{2})\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/85c220877bb7861fd749e3a14ffcb914e25f7d4a)

![{\displaystyle {\begin{aligned}C_{YX}(t_{1},t_{2})&=E\left[\left(Y(t_{1})-\mu _{Y}(t1)\right)\left(X(t_{2})-\mu _{X}(t_{2})\right)\right]\\&=R_{YX}(t_{1},t_{2})-\mu _{Y}(t_{1})\mu _{X}(t_{2})\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1388efdbe5bceb1941eb562ce96d83476279d4da)

Definizione: Indipendenza dei processi

Due processi

e

definiti sullo stesso spazio di probabilità

sono indipendenti se

e questo deve valere:

Definizione: Processi incorrelati

Due processi

e

definiti sullo stesso spazio di probabilità

sono incorrelati se

![{\displaystyle E[X(t_{1})Y(t_{2})]=R_{XY}(t_{1},t_{2})=E[X(t_{1})]\cdot E[Y(t_{2})]=\mu _{X}(t_{1})\mu _{Y}(t_{2})}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6f46dd9c96865c13ea48253710376abeb0635cfa)

Nel caso particolare in cui i processi siano delle variabili casuali gaussiane, allora si ha che

mentre i tutti gli altri casi si ha

Definizione: Processi congiuntamente gaussiani

Un processo

è congiuntamente gaussiano se tutte le densità di probabilità finito-dimensionali sono congiuntamente gaussiane.

Definizione: Processi congiuntamente stazionari in senso stretto

Due processi

e

si dicono congiuntamente stazionari in senso stretto (SSS) se la densità di probabilità congiunta è invariante alla traslazione temporale.

Definizione: Processi congiuntamente stazionari in senso lato

Due processi

e

si dicono congiuntamente stazionari in senso lato (WSS) se:

cioè, anche la crosscorrelazione deve essere funzione della sola distanza tra istanti temporali.

Nel caso di processi congiuntamente stazionari in senso lato (WSS), si ha

e vale

Inoltre, vale

Esempio:

Se

e

sono congiuntamente WSS, l'autocorrelazione di

vale

![{\displaystyle {\begin{aligned}R_{Z}(t,t+\tau )&=E[((X(t_{1})+Y(t_{1}))\cdot (X(t_{2})+Y(t_{2}))]\\&=E[(X(t_{1})X(t_{2})+Y(t_{1})Y(t_{2})+X(t_{1})Y(t_{2})+Y(t_{1})X(t_{2}))]\\&=R_{X}(t_{1},t_{2})+R_{Y}(t_{1},t_{2})+R_{XY}(t_{1},t_{2})+R_{YX}(t_{1},t_{2})\\&=R_{X}(\tau )+R_{Y}(\tau )+R_{XY}(\tau )+R_{YX}(\tau )\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/23d1242a1c6ff21d0425134f72f27c09f2ad0350)

![{\displaystyle \mu _{Z}(t)=E[X(T)+Y(t)]=\mu _{X}(t)+\mu _{Y}(t)=\mu _{X}+\mu _{Y}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/72e6ef65f01f1b3e7121cd9fbd02077915c3c1bc)

Esempio:

Se

e

sono congiuntamente WSS e indipendenti, l'autocorrelazione di

vale

![{\displaystyle \mu _{Z}(t)=E[X(t)Y(t)]=\mu _{X}\mu _{Y}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/985a6d6222f769908da8a506d199e2c28c0413fd)

![{\displaystyle {\begin{aligned}R_{Z}(t,t+\tau )&=E[Z(t)Z(t+\tau )]\\&=E[X(t)Y(t)X(t+\tau )Y(t+\tau )]\\&=E[(X(t)X(t+\tau ))(Y(t)Y(t+\tau ))]\\&=E[X(t)X(t+\tau )]\cdot E[Y(t)Y(t+\tau )]\\&=R_{X}(\tau )R_{Y}(\tau )\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/54b1535a85528dd7385d402ba2770a7d0072cb94)

![{\displaystyle V\sim U[0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b935358dc032fd618980e489414485ee242dc775)

![{\displaystyle (\Omega ,F,P)=\{[0,1],\mathbb {B} ([0,1]),U[0,1]\}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/47df5cb16838eb7886a8bc6edd785d3f9ed4462b)

![{\displaystyle X(t,s)=\left\{{\begin{matrix}1&s\in \left[0,{\frac {1}{T}}\right]\\-1&s\in \left({\frac {1}{T}},T\right]\end{matrix}}\right.{\text{ con }}t\in \{1,2,\cdots ,\infty \}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f574970b2d434571ae7bf09273f1ad5b25824a1b)

![{\displaystyle {\bar {t}}=1\Rightarrow X({\bar {t}},s)=\left\{{\begin{matrix}1&s\in [0,1]\\-1&s\in \varnothing \end{matrix}}\right.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b93892fdef6cd5caf6d292ac9cdaccc933843404)

![{\displaystyle {\bar {t}}=2\Rightarrow X(s,{\bar {t}})=\left\{{\begin{matrix}1&s\in \left[0,{\frac {1}{2}}\right]\\-1&s\in \left({\frac {1}{2}},1\right]\end{matrix}}\right.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/cbbaaadc42e2fb29a3212f595b65cbf0aae85e44)

![{\displaystyle {\bar {t}}=3\Rightarrow X(s,{\bar {t}})=\left\{{\begin{matrix}1&s\in \left[0,{\frac {1}{3}}\right]\\-1&s\in \left({\frac {1}{3}},1\right]\end{matrix}}\right.}](https://wikimedia.org/api/rest_v1/media/math/render/svg/0c70f3f96a4110c8f22dc482ee61afd4bfe11369)

![{\displaystyle {\begin{aligned}P(X(t_{1})=1,X(t_{2})=1)&=P\left(\{s\in \Omega \ |\ X(t_{1},s)=1,X(t_{2},s)=1\}\right)\\&=P\left(\left\{s\in \left[0,{\frac {1}{t_{2}}}\right]\right\}\right)\\&={\frac {1}{t_{2}}}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7a3d92ae1eed15fe1abab4701a063d5cb860e5c6)

![{\displaystyle {\begin{aligned}P(X(t_{1})=1,X(t_{2})=-1)&=P\left(\{s\in \Omega \ |\ X(t_{1},s)=1,X(t_{2},s)=-1\}\right)\\&=P\left(\left\{s\in \left[{\frac {1}{t_{2}}},{\frac {1}{t_{1}}}\right]\right\}\right)\\&={\frac {1}{t_{1}}}-{\frac {1}{t_{2}}}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b97a5e8ef816e7f606637965c48d5533b635c687)

![{\displaystyle {\begin{aligned}P(X(t_{1})=-1,X(t_{2})=-1)&=P\left(\{s\in \Omega \ |\ X(t_{1},s)=-1,X(t_{2},s)=-1\}\right)\\&=P\left(\left\{s\in \left({\frac {1}{t_{1}}},1\right]\right\}\right)\\&=1-{\frac {1}{t_{1}}}\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/21d4549f70af3a42bc7d819223a2b86580dce193)

![{\displaystyle P[X(t_{1}),X(t_{2}),\cdots ,X(t_{n})\in B]\ \forall B\in \mathbb {B(R} ^{n})}](https://wikimedia.org/api/rest_v1/media/math/render/svg/36c2360ed303a422d701b2a4696b80b64bd80caf)

![{\displaystyle U[0,1]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ef4a82b2a883d751cf53e5ac11ea12b9e36298f0)

![{\displaystyle \left[-{\frac {T}{2}},{\frac {T}{2}}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f418869f4a5607f57dcac8bc259d1357eef94186)

![{\displaystyle E\left[A_{X,T}(s)\right]=\mu _{X}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/48c08d3648342d00b450b094f34bb467df355205)

![{\displaystyle E\left[A_{X,T}(s)\right]={\frac {1}{T}}\int _{-{\frac {T}{2}}}^{\frac {T}{2}}E[X(t,s)]dt=\mu _{X}=E[X(t)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6fee5fb3d7a4ea2a25602b1a977d2072db2b8340)

![{\displaystyle C_{X}(\tau )=R_{X}(\tau )-\mu _{V}^{2}=E[V^{2}]-\mu _{V}^{2}=\sigma _{V}^{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/538b4309fa42d67162da54c4bda44664a80f162c)

![{\displaystyle E[X(t)]=\mu _{X}(t)=\mu _{X}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/92ca89e61a152c86df0388e85d5cc855332aacdb)

![{\displaystyle R_{X}(t,t+\tau )=E[X(t)X(t+\tau )]=R_{X}(\tau )=\varphi _{X,T}(\tau ,s)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/03309e54eb13ec9da8cd9713d3619100106c206b)

![{\displaystyle E[\cdot ]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/57d488a22bc9f41e976d3afb6036190bcbb36b2e)

![{\displaystyle S_{X}(f)=\lim _{T\to \infty }{\frac {1}{T}}E\left[\left|X_{T}(f,s)\right|^{2}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/60b31597b3bc87a9a6456db47e998615a69211dc)

![{\displaystyle S_{X}(f)=F[R_{X}(\tau )]=\int _{-\infty }^{+\infty }R_{X}(\tau )e^{-j2\pi f\tau }d\tau }](https://wikimedia.org/api/rest_v1/media/math/render/svg/98b6f65433bfd0a4b56a48117016f76bd0449093)

![{\displaystyle R_{X}(\tau )=F^{-1}\left[S_{X}(f)\right]=\int _{-\infty }^{+\infty }S_{X}(f)e^{j2\pi f\tau }df}](https://wikimedia.org/api/rest_v1/media/math/render/svg/dc8323e23c928318c206e600001abf0c5d90fc56)

![{\displaystyle R_{X}(\tau )=E\left[X(t)X(t+\tau )\right]=E[V^{2}]=\sigma _{V}^{2}+\mu _{V}^{2}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/05c905302ce51d7b89262780d47efb97796144a7)

![{\displaystyle E\left[X(t)\right]=C}](https://wikimedia.org/api/rest_v1/media/math/render/svg/60eeb0476b8321dc6edddfce627ded5fe0277a20)

![{\displaystyle S_{X}(f)={\frac {\sigma ^{2}}{2}}\left[\delta \left(f+{\frac {\omega }{2\pi }}\right)+\delta \left(f-{\frac {\omega }{2\pi }}\right)\right]+C^{2}\delta (f)}](https://wikimedia.org/api/rest_v1/media/math/render/svg/45d2cbea0746caaf0b2ac81bbd3f3e3aaf11a1d0)

![{\displaystyle \mu _{X}(t)=E[X(t)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/52a941c8b898eb09a4557571ffeb722d94054634)

![{\displaystyle \mu _{Y}(t)=E[Y(t)]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/87706b91ec8f7ea5d29f99d5f7b09fdaaa8ff470)

![{\displaystyle R_{X}(t_{1},t_{2})=E\left[X(t_{1})X(t_{2})\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/768107e0c44ef10811bebf152f63f783bad0cf96)

![{\displaystyle R_{Y}(t_{1},t_{2})=E\left[Y(t_{1})Y(t_{2})\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a27d345aa51487aa14ccee0a69eeab8bcf106791)

![{\displaystyle C_{X}(t_{1},t_{2})=E\left[\left(X(t_{1})-\mu _{X}(t1)\right)\left(X(t_{2})-\mu _{X}(t_{2})\right)\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b2b85c7203c174160c0ea9739ca0a5909d9f04b9)

![{\displaystyle C_{Y}(t_{1},t_{2})=E\left[\left(Y(t_{1})-\mu _{Y}(t1)\right)\left(Y(t_{2})-\mu _{Y}(t_{2})\right)\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/5e9999373847279a66a4382830e533393e7c9fe2)

![{\displaystyle R_{XY}(t_{1},t_{2})=E[X(t_{1})Y(t_{2})]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/d81b7d54e2b62ac7af05d4803798687962cc0130)

![{\displaystyle R_{YX}(t_{1},t_{2})=E[Y(t_{1})X(t_{2})]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/221bb8c7f8000a7e3cd414f25f9990c9a739ce63)

![{\displaystyle {\begin{aligned}C_{XY}(t_{1},t_{2})&=E\left[\left(X(t_{1})-\mu _{X}(t1)\right)\left(Y(t_{2})-\mu _{Y}(t_{2})\right)\right]\\&=R_{XY}(t_{1},t_{2})-\mu _{X}(t_{1})\mu _{Y}(t_{2})\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/85c220877bb7861fd749e3a14ffcb914e25f7d4a)

![{\displaystyle {\begin{aligned}C_{YX}(t_{1},t_{2})&=E\left[\left(Y(t_{1})-\mu _{Y}(t1)\right)\left(X(t_{2})-\mu _{X}(t_{2})\right)\right]\\&=R_{YX}(t_{1},t_{2})-\mu _{Y}(t_{1})\mu _{X}(t_{2})\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/1388efdbe5bceb1941eb562ce96d83476279d4da)

![{\displaystyle E[X(t_{1})Y(t_{2})]=R_{XY}(t_{1},t_{2})=E[X(t_{1})]\cdot E[Y(t_{2})]=\mu _{X}(t_{1})\mu _{Y}(t_{2})}](https://wikimedia.org/api/rest_v1/media/math/render/svg/6f46dd9c96865c13ea48253710376abeb0635cfa)

![{\displaystyle {\begin{aligned}R_{Z}(t,t+\tau )&=E[((X(t_{1})+Y(t_{1}))\cdot (X(t_{2})+Y(t_{2}))]\\&=E[(X(t_{1})X(t_{2})+Y(t_{1})Y(t_{2})+X(t_{1})Y(t_{2})+Y(t_{1})X(t_{2}))]\\&=R_{X}(t_{1},t_{2})+R_{Y}(t_{1},t_{2})+R_{XY}(t_{1},t_{2})+R_{YX}(t_{1},t_{2})\\&=R_{X}(\tau )+R_{Y}(\tau )+R_{XY}(\tau )+R_{YX}(\tau )\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/23d1242a1c6ff21d0425134f72f27c09f2ad0350)

![{\displaystyle \mu _{Z}(t)=E[X(T)+Y(t)]=\mu _{X}(t)+\mu _{Y}(t)=\mu _{X}+\mu _{Y}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/72e6ef65f01f1b3e7121cd9fbd02077915c3c1bc)

![{\displaystyle \mu _{Z}(t)=E[X(t)Y(t)]=\mu _{X}\mu _{Y}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/985a6d6222f769908da8a506d199e2c28c0413fd)

![{\displaystyle {\begin{aligned}R_{Z}(t,t+\tau )&=E[Z(t)Z(t+\tau )]\\&=E[X(t)Y(t)X(t+\tau )Y(t+\tau )]\\&=E[(X(t)X(t+\tau ))(Y(t)Y(t+\tau ))]\\&=E[X(t)X(t+\tau )]\cdot E[Y(t)Y(t+\tau )]\\&=R_{X}(\tau )R_{Y}(\tau )\end{aligned}}}](https://wikimedia.org/api/rest_v1/media/math/render/svg/54b1535a85528dd7385d402ba2770a7d0072cb94)